Hadoop新子项目HDDS 解决分布式数据存储瓶颈与扩展性问题

随着大数据技术的快速发展,Hadoop作为开源分布式计算框架的核心,面临着数据存储层长期存在的瓶颈和扩展性挑战。传统HDFS在应对海量小文件、元数据管理和跨数据中心复制等场景时效率受限,难以满足现代企业对高性能、高可扩展性存储的需求。为了突破这些限制,Apache Hadoop社区推出了新的子项目HDDS(Hadoop Distributed Data Storage),旨在重构分布式数据存储层,提供更高效的数据处理和存储支持服务。

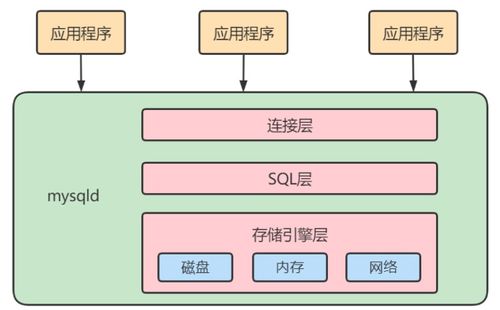

HDDS的核心设计理念是将存储逻辑与计算逻辑进一步解耦,通过引入分层存储架构和智能元数据管理,显著提升数据存取速度和系统扩展性。其关键技术包括:

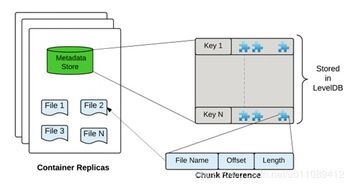

- 容器化存储模型:将数据块组织为逻辑容器,减少元数据开销,支持快速数据定位和迁移。

- 动态扩展机制:允许存储节点按需横向扩展,无需中断服务,实现存储容量的弹性增长。

- 多协议支持:兼容HDFS、S3等存储协议,确保与现有Hadoop生态组件的无缝集成。

- 数据分层与缓存优化:根据访问频率自动调整数据存储层级,结合缓存策略降低I/O延迟。

在信息处理方面,HDDS通过优化数据本地性策略和并行读写机制,提升了MapReduce、Spark等计算框架的任务执行效率。同时,其增强的存储支持服务包括数据压缩、加密和容灾备份功能,为企业级应用提供了可靠的数据管理保障。

实际部署案例显示,采用HDDS的Hadoop集群在处理PB级数据时,写入性能提升了约30%,元数据操作延迟降低了50%以上。这不仅解决了传统Hadoop的存储瓶颈,还为人工智能、物联网等数据密集型应用奠定了坚实的基础。未来,随着HDDS的持续演进,Hadoop生态系统将更好地支撑云原生和边缘计算场景,推动分布式存储技术迈向新的里程碑。

如若转载,请注明出处:http://www.iotloader.com/product/2.html

更新时间:2025-11-29 23:57:19